Científicos crean un implante cerebral que utiliza la IA para leer la mente y convierte los pensamientos en habla

Una interfaz cerebro-computadora registra señales neuronales que facilita la comunicación asistida en pacientes con discapacidades severas mediante un sistema de voz sintética.

- Investigadores coreanos crean el primer fármaco que podría regenerar la visión y eliminar la ceguera

- Sol artificial de China alcanza los 100 millones °C de temperatura y abre nuevas posibilidades para la fusión

Un equipo de investigadores de la Universidad de California ha desarrollado un implante cerebral que decodifica los pensamientos de una persona y los transmite por un altavoz mediante la inteligencia artificial. El avance, publicado en Nature Neuroscience, marca la primera vez que los investigadores han logrado una transmisión casi sincronizada entre el cerebro y la voz.

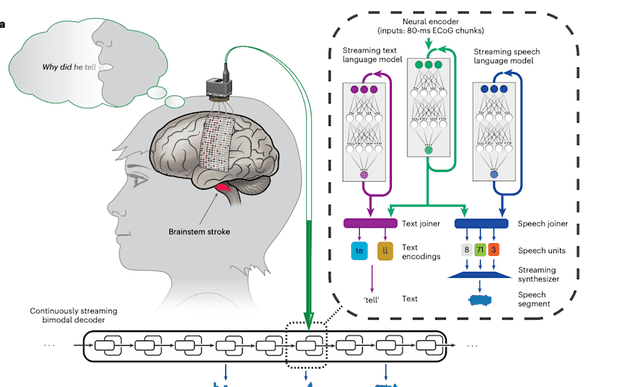

La innovación se basa en una interfaz cerebro-computadora (BCI) que decodifica señales neuronales de la corteza motora, encargada del control del habla. La IA interpreta estos datos casi en tiempo real y los transmite a través de un sistema de voz sintética. Esta herramienta ayudaría a la comunicación asistida en pacientes con discapacidades severas.

PUEDES VER: Científicos descubren arañas marinas y otras especies tras desprendimiento de iceberg en la Antártida

¿Cómo funciona el implante cerebral?

El dispositivo consiste en una neuroprótesis equipada con 253 electrodos cerebrales que se colocan sobre la superficie del cerebro. Estos sensores registran la actividad neuronal relacionada con el habla, captando las señales justo en el momento en que el pensamiento se transforma en intención motora.

Esquema sobre el funcionamiento del implante cerebral con su interfaz. Foto: Cheol Jun Cho

A partir de estos datos, la IA médica realiza una decodificación neuronal que transforma los impulsos en palabras audibles. Según el ingeniero Gopala Anumanchipalli, investigador de la Universidad de California en Berkeley, el sistema emplea algoritmos similares a los de asistentes virtuales como Siri o Alexa, pero adaptados a un entorno neurológico. El sistema capta información cada 80 milisegundos, lo que permite una respuesta fluida y una experiencia de habla en tiempo real.

PUEDES VER: Investigación científica revela que las pirámides de Egipto no fueron mausoleos únicamente para faraones

La primera persona en utilizar el nuevo implante

La persona identificada como Ann, es una mujer que sufrió un derrame cerebral en 2005, fue la primera paciente en participar en las pruebas. La parálisis que resultó del accidente le impidió hablar, pero accedió a colaborar con el equipo de científicos permitiendo la implantación del dispositivo.

Durante las pruebas, se le mostró texto en una pantalla para que intentara pronunciarlo mentalmente. La inteligencia artificial relacionó estas señales con palabras específicas, lo que permitió reconstruir frases completas y emitirlas mediante un sistema de voz sintética. Esta experiencia marcó un paso decisivo en el uso de prótesis cerebral como herramienta de comunicación.

¿Qué avances ofrece esta nueva versión del implante?

La versión presentada en 2024 mejora significativamente respecto al prototipo de 2023. La anterior necesitaba esperar la frase completa para emitirla, con un retraso de hasta ocho segundos. Ahora, el sistema procesa palabra por palabra, reduciendo la latencia a solo tres segundos.

"Básicamente, interceptamos señales donde el pensamiento se traduce en articulación y en medio de ese control motor", explicó en un comunicado Cheol Jun Cho, coautor del estudio. "Así pues, lo que decodificamos ocurre después de que un pensamiento ha surgido, después de haber decidido qué decir, después de haber decidido qué palabras usar y cómo mover los músculos del tracto vocal".